Qué

Taller sobre captura masiva de tuits de la plataforma Twitter (realizado con t-hoarder) y análsis de los mismos con Gephi. Todo realizado con software libre.

- En la primera parte estará centrada en las diferentes estrategias para obtener datos (tuits) de la página web de Twitter y se introducirá al uso de t-hoarder.

- En la segunda parte usaremos los datos obtenidos para visualizarlos con Gephi.

Puedes ver un ejemplo de análisis de Twitter como este Antes y después de la muerte de Rita Barberá en Twitter.

Necesidades para el taller

Trae descargado/instalado de casa:

- Instala el programa Python (Python 2.7.12 o superior siempre que sea 2.7. No se garantiza el funcionamiento en 3.x).

- Instala Gephi.

- También habrá una máquina virtual en Linux para uso de los participantes, así todos compartiríamos sistema operativo cuando usemos t-hoarder. Para acceder a ella hace falta instalar Virtualbox.

Descargar la máquina virtual aquí (3,7Gb) [link actualizado 6 marzo 2017]. Para quien no pueda descargarlo tendremos disponible un pendrive durante toda la sesión.

Diapositivas y código

Los scripts del taller están disponibles en el repositorio https://github.com/congosto/t-hoarder_kit

Diapositivas de la presentación: introducción y taller (.pdf, 18Mb)

Datos

Se partirá de los datos previamente recopilados de Twitter sobre diferentes temas.

Quién

Impartido por Mari Luz Congosto. Doctora en Telemática por la Universidad Carlos III y licenciada en Informática por la Universidad Politécnica de Madrid. Investiga sobre la propagación y caracterización de usuarios en Twitter dentro del entorno de los datos socio-políticos. Ha desarrollado la plataforma t-hoarder para capturar y visualizar datos sociales de Twitter y la plataforma metroaverias para medir la calidad del metro de Madrid percibida pos sus usuarios. Anteriormente trabajó durante 20 años en Telefónica I+D. Actualmente publica artículos en Bez.es e imparte clases de captura de datos y visualización de datos en varios Masters de periodismo de datos y de Big Data.

Tecnologías

Ttaller basado en el programa de captura de tuits de Twitter t-hoarder desarrollado por Mari Luz Congosto. Puedes acceder al repositorio del proyecto t-hoarder.

Imagen: de la visualización de Congosto.

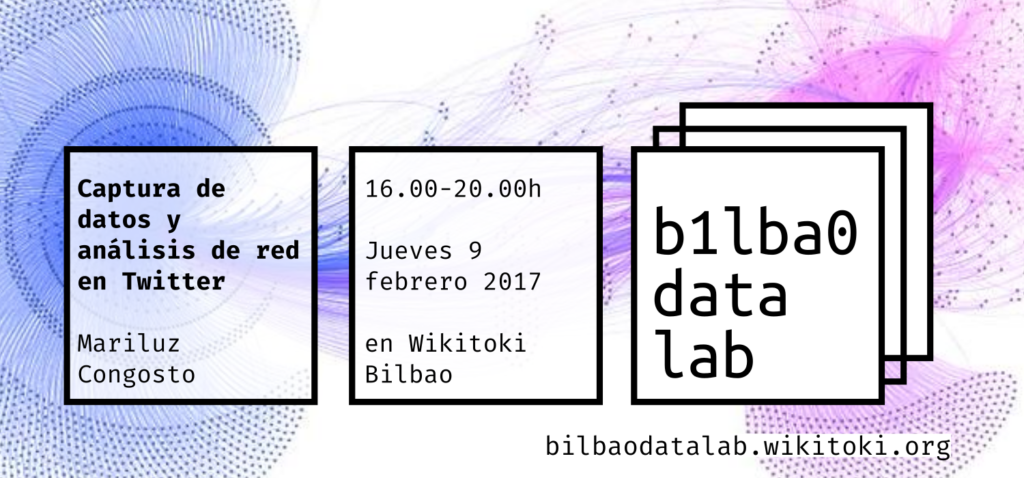

Cuándo y dónde

La próxima sesión de Bilbao Data Lab será el próximo jueves 9 de febrero de 2017 en Wikitoki (Plaza La Cantera, 5 – 2. Bilbao).

Actividad gratuita. No requiere inscripción previa.

Horario: 16.00h a 20.00h.

Por favor, confirma tu asistencia al taller apuntandote en el doodle.

Egun on,

¿Sería posible acceder a las actividades que organizáis vía streaming?

Me resultan de gran interés pero me es imposible acceder presencialmente.

Eskerrik asko!

Aupa Markel,

estamos trabajando para poder hacer streming de las sesiones, es algo que llevamos planeando desde hace tiempo, pero aun tenemos que resolver algún tema técnico.

De todas formas a los pocos días de las sesiones publicamos en youtube las jornadas enteras y ponemos el código y las presentaciones en github para que se pueda seguir el taller aunque sea en diferido.

Esperamos poder empezar a retransmitir las sesiones por streaming pronto.

Muchas gracias!

Estaré atento al canal de Youtube.

Un saludo.

Hola, una duda sobre el taller:

¿es posible teniendo python 2.7.x y Gephi instalado en nuestro equipo hacer el taller sin necesidad de instalar VirtualBox y utilizar la máquina virtual?

Según me comenta Mariluz:

Sí, se puede hacer de las dos maneras, pero la máquina está empaquetada para que sea más fácil y se use la consola lo menos posible. La máquina ocupa 3.3 gigas y cuando funciona consume un giga. Esta hecha para entornos mínimos. Tendrían que instalarse los scripts.

Lo que nos va a dar es un kit completo de test y streaming más un script que genera los grafos y si hay tiempo otro que accede a una API de análisis de sentimiento. Esto es muy útil para hacer cosas a corto plazo.

El t-hoarder es para experimentos de largo plazo y en 4 horas no se puede explicar.

Hola chicos

Una pregunta: ¿Tenéis intención de subir esta sesión a youtube para que podamos verla los que no pudimos asistir??

Yo estaría muy interesada…

Muchas gracias.

Sí, la vamos a subir. Hemos tenido unos problemas técnicos, pero en unos días estará lista.

Muchas gracias

Tiene pinta de ser muy interesante!!!